מדענים מאוניברסיטת קרקוב לטכנולוגיה (PK) עובדים על גלאי זיוף עמוק בווידאו, אודיו ותמונות. הם מתכננים להשתמש בטכניקות מודרניות המבוססות על רשתות עצביות ושיטות למידה עמוקה (deep learning) כדי להילחם בזיופים עמוקים.

העבודה על הפרויקט "זיהוי תוכן אודיו-וידאו שעבר מניפולציה כדי להגן מפני הפצת הודעות זיוף עמוק" מתבצעת במסגרת תחרות "Infostrateg" הראשונה של המרכז הלאומי למחקר ופיתוח. צוות קרקוב קיבל מימון של כמעט 4 מיליון זלוטי.

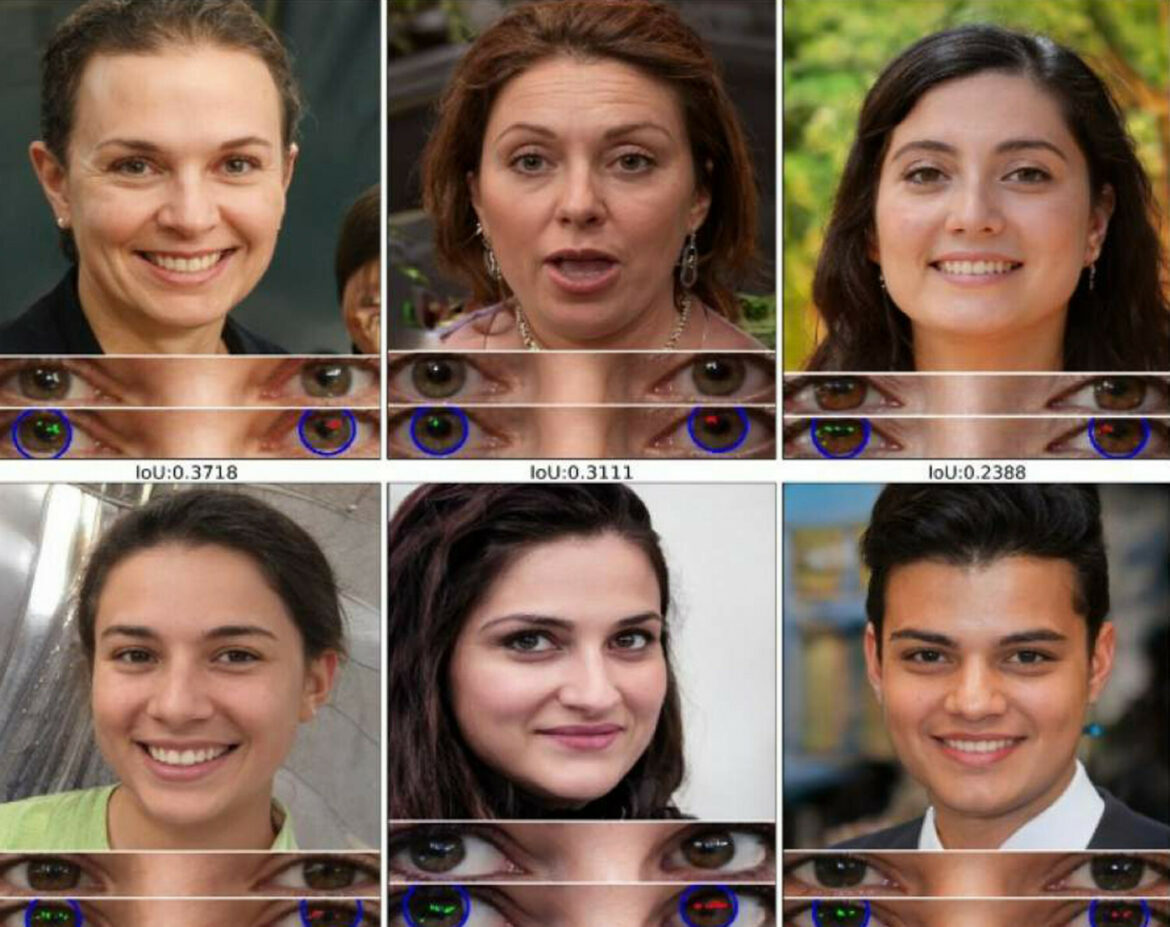

מנהל הפרויקט, ד"ר להנדסה מיכל ברטה מהפקולטה למדעי המחשב ותקשורת של האוניברסיטה הטכנולוגית בקרקוב, טוען שניתן להשתמש באותן שיטות של למידת מכונה המשמשות להפקת תוכן זיוף עמוק כדי לזהות תוכן שעבר מניפולציה.

כתוצר סופי, הצוות שלו הולך ליצור מערכת אוטומטית לאימות תוכן התמונה/צליל/וידאו לשימוש עובדי תקשורת, משרדי מערכת, סוכנויות יחסי ציבור וארגונים אחרים המגנים על תדמית הלקוחות והמוצרים שלהם, אינטרנט ורשתות חברתיות, המשטרה ושירותי ביטחון נוספים, ארגונים לא ממשלתיים וכל מי שמעוניין לבדוק את אמינות התוכן.

מדענים מהאוניברסיטה הטכנולוגית בקרקוב צופים שבדומה למרוץ חימוש מתמיד בין מייצרים וירוסים במחשב למייצרי תוכנות אנטי-וירוס, יתרחש מצב דומה בין יוצרי החומרים המזויפים והחוקרים של הרשתות העצביות והמחשוב המהפכני, שינסו לפתח את השיטות הטובות ביותר לזיהוי של אותם זיופים.

פרופ' מיכל ברטה סבור שהנטייה של תקשורת high-profile לבצע נסיונות של שימוש בחומרים מזויפים לצורך מאבק פוליטי, השמצה או הונאה הופכת את הפרויקט שלו למבוקש עוד יותר על ידי השוק.

אדריאן אנדז'יבסקי